Encadrer l’intelligence artificielle qui façonne l’attention

Tous les mécanismes de captation de l’attention ne reposent pas sur l’intelligence artificielle.

Notifications, défilement infini ou lecture automatique relèvent avant tout de choix de design.

Cependant, une part croissante de ces mécanismes s’appuie aujourd’hui sur des systèmes d’intelligence artificielle, en particulier lorsqu’il s’agit de récolter les données et de personnaliser l’expérience utilisateur.

C’est dans ce contexte que s’inscrit le règlement européen dédié à ces systèmes : l’IA Act.

Qu’est-ce que l’IA Act ?

Entré en vigueur le 1ᵉʳ août 2024, l’IA Act constitue le premier cadre juridique européen spécifiquement dédié aux systèmes d’intelligence artificielle.

Il s’applique à tout acteur qui développe, met sur le marché ou utilise un système d’IA dans l’Union européenne, y compris lorsque cet acteur est établi en dehors de l’UE.

L’IA Act poursuit deux objectifs :

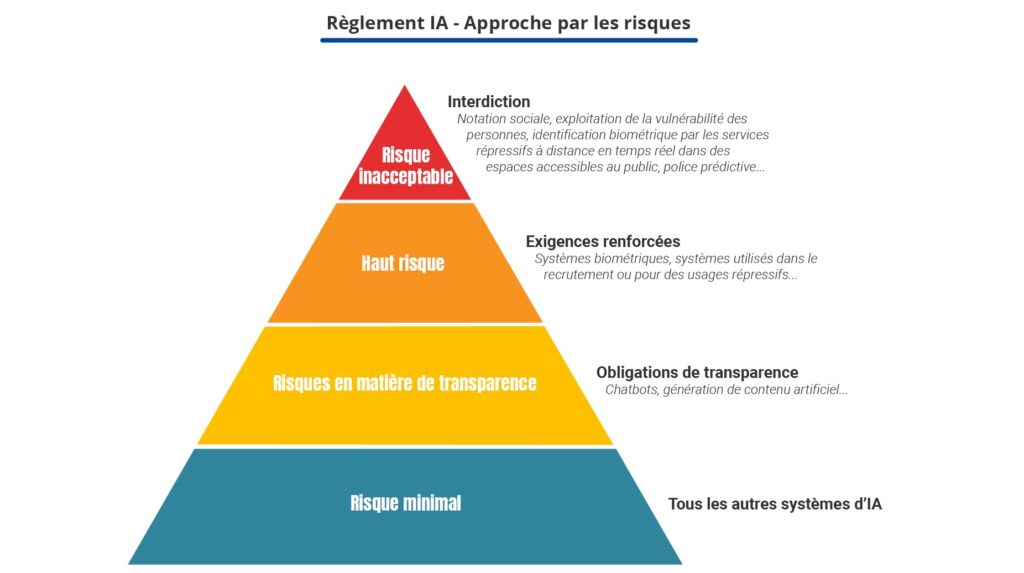

Une régulation fondée sur le niveau de risque

L’IA Act repose sur une approche graduée : plus un système d’IA présente de risques pour les droits ou la société, plus il est encadré.

Quatre catégories de risque ont ainsi été définies, chacune associée à un régime juridique spécifique.

Les systèmes à risque inacceptable : interdits

Certains systèmes d’IA sont jugés incompatibles avec les valeurs de l’Union européenne.

Ils sont considérés comme présentant un danger grave pour les droits fondamentaux ou la sécurité collective, et sont donc strictement interdits.

C’est le cas de la reconnaissance faciale en temps réel dans l’espace public à des fins de surveillance généralisée.

Les systèmes à haut risque : autorisés mais strictement encadrés

Les systèmes classés à haut risque ne sont pas interdits, mais font l’objet d’un encadrement renforcé en raison de leur impact potentiel significatif sur la vie des individus. Ils sont soumis à des exigences strictes.

Ils concernent notamment le recrutement et la sélection automatisée de candidat·es.

Ces systèmes doivent faire l’objet d’évaluations de risques, de contrôles humains et de garanties en matière de transparence et de sécurité.

Les systèmes à risque limité : transparence obligatoire

Certains systèmes ne présentent pas de danger direct, mais peuvent influencer les comportements ou les perceptions des utilisateur·rices.

Nous pouvons citer les IA conversationnelles et les générateurs de textes ou d’images par exemple.

Les systèmes à risque faible : usage libre

Enfin, les systèmes d’IA considérés comme à risque faible, comme les filtres anti-spam sur la boîte mail, ne sont soumis à aucune obligation réglementaire spécifique.

Ils peuvent être librement développés et utilisés, même si l’IA Act encourage l’adoption de bonnes pratiques volontaires.

Quelle est la place des algorithmes de recommandation ?

Bien que l’IA Act soit entré en vigueur en 2024, il ne s’applique pas encore pleinement. Sa mise en œuvre est progressive, avec des échéances étalées jusqu’en août 2026.

À ce stade, la place exacte des algorithmes de recommandation dans la pyramide des risques reste partiellement à préciser. Leur position dépendra également des usages, des publics et des effets constatés.

Deux hypothèse s’offrent à nous :

Cas général : risque limité

Ils n’enfreignent pas directement un droit fondamental et ne prennent pas de décisions contraignantes à la place de l’utilisateur·rice, mais influencent ses comportements en orientant ce qu’il·elle voit et à quel moment.

Pour cette raison, ils restent autorisés, mais sont soumis à des obligations de transparence : informer l’utilisateur·rice de l’usage de l’IA, expliquer les grands critères de recommandation et proposer, le cas échéant, une alternative sans personnalisation, en cohérence avec le DSA.

Basculement dans le haut risque

Cette bascule devient plausible lorsque l’IA cible des publics particulièrement vulnérables, comme les mineur·es, ou exploite des données sensibles. Elle est également envisagée lorsque des effets négatifs documentés apparaissent.

Par exemple, un système de recommandation capable d’identifier un état de détresse psychologique et d’amplifier volontairement la diffusion de contenus anxiogènes ou extrêmes pourrait être considéré comme présentant un risque significatif pour les droits fondamentaux et la sécurité des personnes. Dans ce cas, un classement en « haut risque » devient juridiquement crédible.

À retenir